ADUULM-Dataset

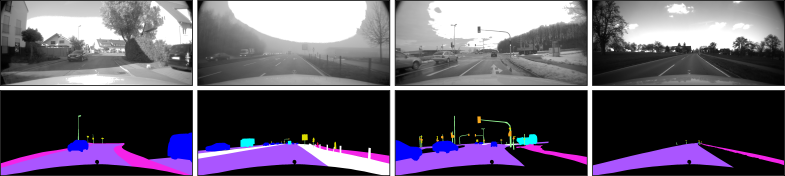

Eine der zentralen Herausforderungen heutiger semantischer Segmentierungsansätze ist, robuste und zuverlässige Segmentierungsergebnisse nicht nur bei guten Wetterbedingungen, sondern auch in Schlechtwetterbedingungen wie Dunkelheit, Nebel oder starkem Regen zu erhalten. Dazu werden zahlreiche Sensordaten unterschiedlicher Sensorarten wie Kamera und Lidar benötigt, um die Störanfälligkeit einzelner Sensoren in Schlechtwetterbedingungen zu kompensieren. Das Problem aktueller Segmentierungsdatensätze wie z.B. Cityscapes, BDD oder Apollo-Scapes ist, dass diese Datensätze nur Kameradaten enthalten, aber für eine robuste semantische Segmentierung in Schlechtwetterbedingungen viele unterschiedliche Sensortypen notwendig sind. Diese Beobachtung motivierte uns zum Aufbau des ADUUlm-Dataset, ein Datensatz, der Kamera- und Lidar-Daten und die entsprechenden zeitlichen Informationen enthält. Die wichtigsten Beiträge des ADUUlm-Datensatzes sind:

- Einer der ersten semantischen Segmentierungsdatensätze, der fein annotierte Kamerabilder und pixelweise gelabelte Lidar-Daten enthält und zeitliche Informationen in kurzen ROS-Sequenzen zur Verfügung stellt.

- Der Datensatz enthält zahlreiche Schelchtwetterdaten, wie z.B. starker Regen, Dunkelheit oder Nebel.

- Weitere Informationen können unserem BMVC-Paper entnommen werden.

Datensatz Übersicht

- Städtische und ländliche Szenarien in der Umgebung von Ulm (Deutschland) und bei verschiedenen Wetterbedingungen (z.B. sonnig, regnerisch, neblig, Nacht, ...)

- Sensor-Setup: Kameras, Lidars, Stereo, GPS, IMU

- 12 Klassen (car, truck, bus, motorbike, pedestrian, bicyclist, traffic-sign, traffic-light, road, sidewalk, pole, unlabelled)

- 3482 fein annotierte Kameradaten

- Trainingsdaten: 1414 (ausschließlich optimale Wetterbedingungen)

- Validierungsdaten: 508 (ausschließlich optimale Wetterbedingungen)

-

Testdaten: 1559 (unterschiedliche Wetterbedingungen)

- Geeignet für Semantische Segmentierung, Freiraumerkennung, ...

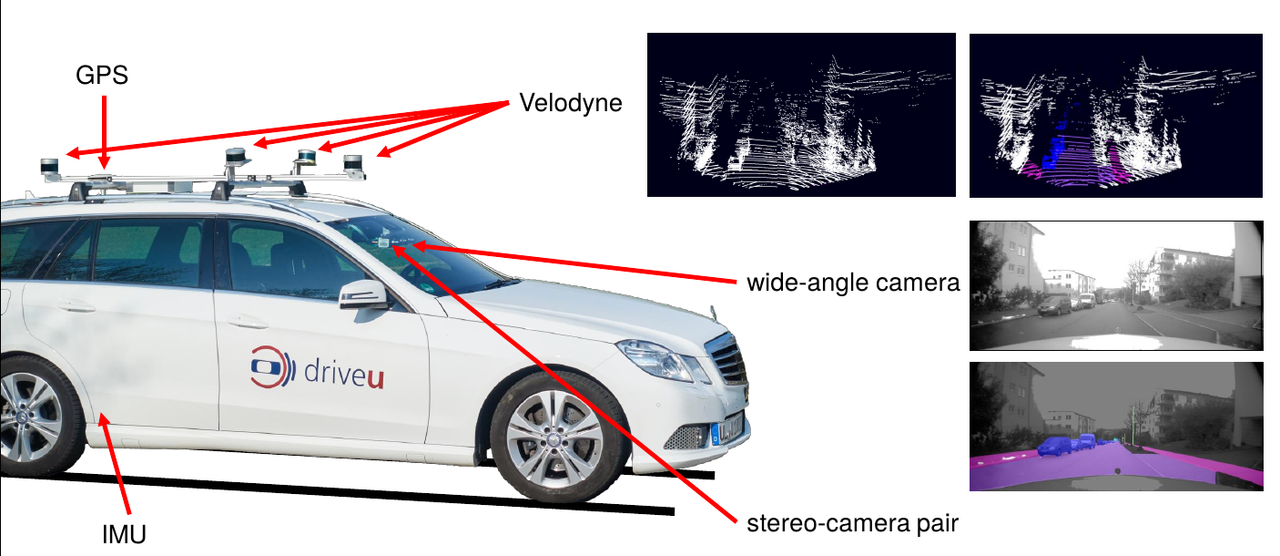

Datengenerierung und Sensor-Setup

Dieser Datensatz wurde von unserem Testfahrzeug während der Fahrt in und um Ulm (Deutschland) zu verschiedenen Tages- und Jahreszeiten und bei verschiedenen guten und schlechten Wetterbedingungen wie Nebel, Schnee oder (starkem) Regen aufgenommen. Unser Testfahrzeug ist mit den folgenden Sensoren ausgestattet:

- Weitwinkelkamera (Auflösung: 1920x1080)

- Stereokamerapaar (Auflösung: 1920x1080)

- Rückfahrkamera (Auflösung: 1392x1040)

- Vier Lidar-Sensoren (Velodyne 16/32) auf dem Fahrzeugdach

- IMU

- GPS

Nutzung der Daten

In unserem Github Repository stellen wir verschiedene Python-Skripte für den Datensatz zur Verfügung:

Download

Klicken Sie hier zur Registrierung und zum Download der Daten

Referenzen

Bitte vergessen Sie nicht, unser BMVC2020 Paper zu zitieren, wenn Sie den ADUUlm-Datensatz für Ihre wissenschaftliche Arbeit verwenden:

@InProceedings{Pfeuffer_2020_TheADUULM-Dataset,

Title = {The ADUULM-Dataset - A Semantic Segmentation Dataset for Sensor Fusion},

Author = {Pfeuffer, Andreas and Sch{\"o}n, Markus and Ditzel, Carsten and Dietmayer, Klaus},

Booktitle= {31th British Machine Vision Conference 2020, {BMVC} 2020, Manchester, UK, September 7-10, 2020},

Year= {2020},

Publisher= {{BMVA} Press}

}

Publikationen, die auf dem ADUUlm-Dataset basieren

2019:

2020: