Der Verkabelungsassistent

Situations- und Benutzeradaptive Funktion von kognitiven technischen Systemen

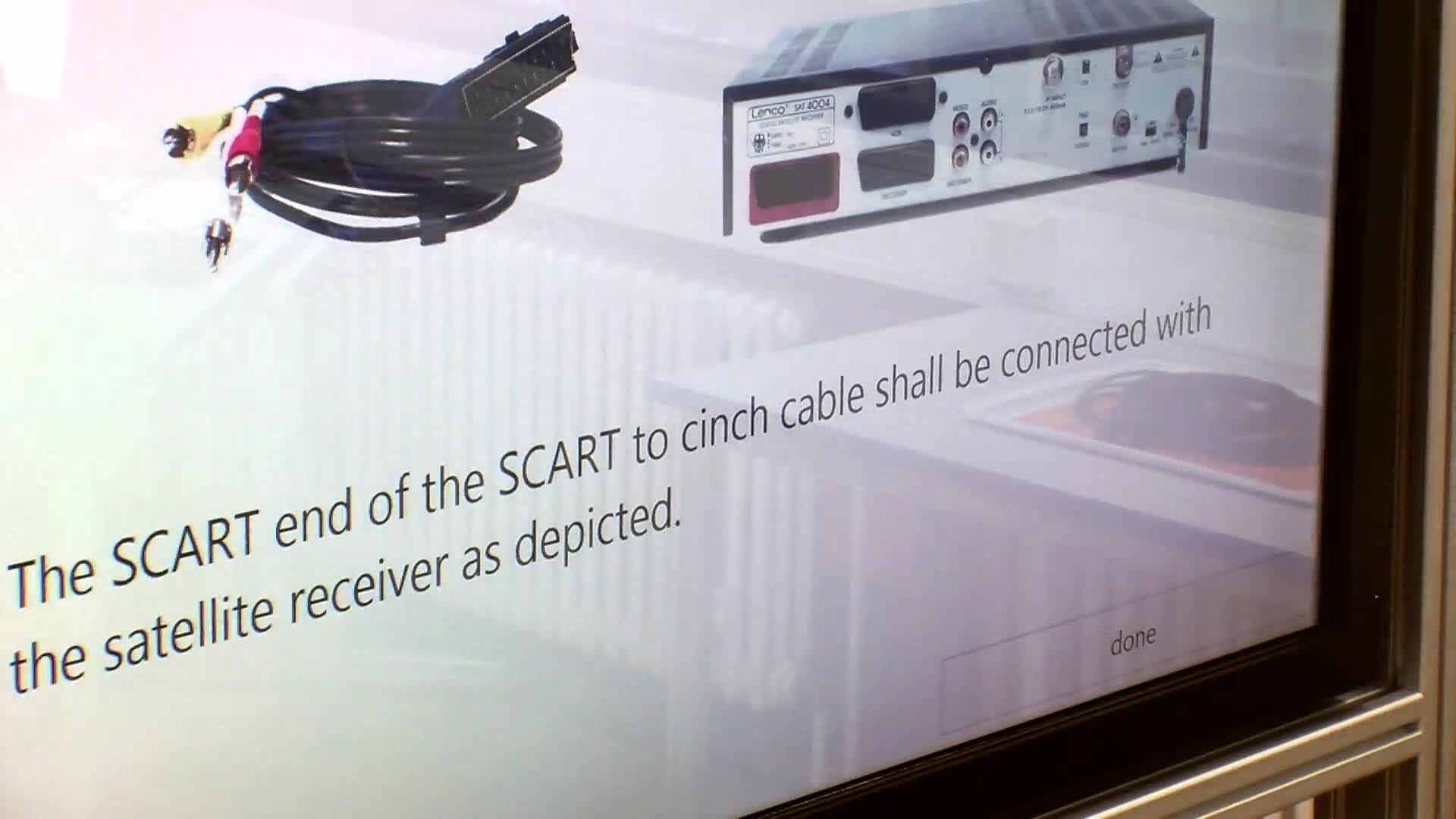

Der Film zeigt wie die Komponenten eines Companion-Systems zusammenspielen. Hier realisieren sie ein Assistenzsystem, das beim Verkabeln einer komplexen Heimkinoanlage hilft. Das System stellt sich individuell auf den jeweiligen Nutzer und dessen Umgebung ein. Es erzeugt mit Methoden der intelligenten Handlungsplanung zunächst eine passende Verkabelungsanleitung. Durch eine adaptive Dialog- und Interaktions-steuerung ist es in der Lage, diese zu kommunizieren und multimodal mit dem Nutzer zu interagieren. Wissen über die Vorkenntnisse des Nutzers und seine Kommunikationspräferenzen ermöglicht dabei eine individuelle Anpassung der Nutzer-Systeminteraktion. Mittels formalisierten Wissens über das technische Zubehör der Heimkinoanlage können darüber hinaus jederzeit situations- und nutzergerechte Erklärungen zur vorgeschlagenen Vorgehensweise gegeben werden. Planreparatur-mechanismen erlauben dem System außerdem spontan auf unerwartet auftretende Fehler während der Verkabelung zu reagieren.

Link zum Video: mittlere Auflösung / hohe Auflösung

Der Fahrkartenkauf

Multimodale Informationsverarbeitung

Das Szenario demonstriert multimodale, situations- und emotionsadaptive Interaktionsmöglichkeiten zwischen Mensch und technischem System am Beispiel des Erwerbs einer Bahnfahrkarte. Es wird gezeigt, wie sich ein Companion-fähiges technisches System aus der gleichzeitigen Auswertung mehrerer expliziter und impliziter Eingabedaten in seinem Mensch-Maschine-Dialog an den Situationskontext und die Nutzeremotion anpassen kann. Der Dialog mit dem Gerät kann über für den Nutzer frei wählbare und auch änderbare Eingabemodalitäten erfolgen: über den klassischen Touchscreen und gesprochene Sprache, aber auch über innovative Konzepte wie die Steuerung über Gesten oder Mimik. Zudem wird gezeigt, wie Hintergrund- und Planwissen, beispielsweise zu häufig bereisten Zielen, dem Terminkalender oder der Anzahl der Reisenden eingebracht werden kann.

Link zum Video: mittlere Auflösung / hohe Auflösung

Das LAST-MINUTE-Experiment

Emotionsinduktion und Emotionserkennung

Das Szenario präsentiert Emotions- und Spracherkennung im Dialog sowie die Verwendung multimodaler Kommunikationssignale des Nutzers durch ein Companion-System. Die Demonstration bedient sich eines Dialoges zwischen Nutzer und Companion-System, wobei das System verbal und visuell Aufgaben präsentiert, die der Proband mittels Spracheingabe bearbeitet. In dem so genannten LAST-MINUTE-Experiment mit über 130 Versuchspersonen wurde untersucht, auf welche Weise Menschen mit solchen „sprechenden Systemen“ interagieren, wenn ihnen keine Vorgaben gemacht werden, und welche Probleme bei einem Dialog zwischen Mensch und System auftauchen können, wenn eine alltägliche Situation des Planens, Umplanens und des Strategiewechsels bewältigt werden soll. Anhand von Sprachinhalt und Diskursverlauf, die realzeitlich automatisch ausgewertet werden, werden systematisch Companion-Interventionen eingeleitet. Diese sind als unterstützende und erklärende Kommentare mit stressminderndem Charakter gestaltet.

Link zum Video: mittlere Auflösung