Seminar: Generatives maschinelles Lernen: Anwendungen neuronaler Netze bei räumlicher stochastischer Modellierung

Die quantitative Analyse digitaler (Bild-)Daten ist ein wichtiges Instrument in verschiedenen wissenschaftlichen Disziplinen wie Medizin, Geographie, Wettervorhersage oder Materialwissenschaft. Mathematische Techniken zur Mustererkennung oder zur Beschreibung komplexer Bildstrukturen mit Hilfe von räumlichen stochastischen Modellen können wertvolle Beiträge leisten. Die stochastische Geometrie bietet eine breite Palette an räumlichen stochastischen Modellen für verschiedene Anwendungen, z. B. Punktprozesse zur Beschreibung von Punktmustern im Raum, Zufallsgraphen zur Modellierung komplexer Netzwerkstrukturen und Zufallsmosaike zur Beschreibung von Mosaiken (zellulare oder granulare Strukturen).

Oft erfordern solche Techniken aber explizite Informationen über die Daten, die nur schwer zugänglich sind. In jüngster Zeit haben sich daher Methoden des maschinellen Lernens als nützliches Werkzeug für die Bildverarbeitung und damit auch für die räumliche stochastische Modellierung erwiesen. So können z. B. neuronale Faltungsnetze zur Verbesserung der Bildverarbeitung eingesetzt werden, die oft ein notwendiger Schritt vor der Modellierung ist. Darüber hinaus werden Methoden des maschinellen Lernens zur Vorhersage physikalischer Eigenschaften wie z. B. der Leitfähigkeit von räumlichen stochastischen Modellen verwendet, die ansonsten nur schwer zu berechnen sind. Andererseits können sogenannte generative Netzwerke eingesetzt werden, um direkt neue virtuelle Bilddaten zu erzeugen, welche einem bekannten Datensatz ähnlich sind.

In diesem Seminar werden wir uns daher auf den Einsatz von Techniken des machinellen Lernens in der stochastischen Modellierung fokussieren, wie z.B. Faltungsnetzwerke zur Segmentierung von Bilddaten, generative Netzwerke zum Erzeugen neuer Bilddaten, oder physikalisch informierte Netzwerke zur Vorhersage bestimmter Transporteigenschaften einer Mikrostruktur. Darüber hinaus werden

werden verschiedene wissenschaftliche Studien diskutiert, die die vorgestellten Methoden nutzen. Das Seminar eignet sich als Vorbereitung für die Anfertigung einer Bachelor- oder Masterarbeit zu ähnlichen Themen.

| Voraussetzungen: | Wahrscheinlichkeitsrechnung |

| Zielgruppe: | Bachelor and Master Studenten in "Wirtschaftsmathematik", "Mathematik", "Mathematische Biometrie", "CSE" oder "Lehramt Mathematik" |

| Credits: | 4 |

| Zeit und Ort: | Donnerstags 14:00-16:00; Raum 220, Helmholtzstraße 18 Erstes Treffen zur Themenvergabe: 17. Oktober |

| Anmeldung: | per mail an Phillip Gräfensteiner |

Kontakt

Seminar Supervisor

Prof. Dr. Volker Schmidt

E-Mail: volker.schmidt@uni-ulm.de

Dr. Orkun Furat

E-Mail: orkun.furat@uni-ulm.de

Seminar Advisor

Phillip Gräfensteiner

E-Mail: phillip.graefensteiner@uni-ulm.de

Liste von Vorträgen:

Fundamental Concepts of Stochastic Geometry – Point Processes and Random Tesselations

| Speaker: | Ines Götschel |

| Date: | 14.11.2024 |

In order to assess whether a given random realization of a model is similar to a given measured data set of a microstructured functional material, and in which sense this similarity holds, we require some fundamental concepts from stochastic geometry and probability theory [1]. This includes notions of random variables, fields, random closed sets, as well as basic characteristics and geometric descriptors used to obtain a statistical description, such as the covariance function of a random field or geometric descriptors such as volume fraction or geodesic tortuosity of a given random set.

[1] S.N. Chiu, D. Stoyan, W.S. Kendall, J. Mecke. Stochastic Geometry and its Applications, J. Wiley & Sons (2013).

Fundamental Concepts of Stochastic Geometry – Random Fields and Excursion Sets

| Speaker: | Enes Akinci |

| Date: | 14.11.2024 |

In order to assess whether a given random realization of a model is similar to a given measured data set of a microstructured functional material, and in which sense this similarity holds, we require some fundamental concepts from stochastic geometry and probability theory [1]. This includes notions of random variables, fields, random closed sets, as well as basic characteristics and geometric descriptors used to obtain a statistical description, such as the covariance function of a random field or geometric descriptors such as volume fraction or geodesic tortuosity of a given random set.

[1] S.N. Chiu, D. Stoyan, W.S. Kendall, J. Mecke. Stochastic Geometry and its Applications, J. Wiley & Sons (2013).

What is Machine Learning? An Overview of different Tasks and Approaches

| Speaker: | Tatjana Shevchik |

| Date: | 21.11.2024 |

For a general understanding and a short overview in the field of machine learning, different machine learning approaches and typical problems are briefly summarized. For example, techniques of un-supervised learning such as priniciple component analysis, Q-learning, reinforcement learning, and techniques of supervised learning, such as linear regression, random forest classifier and recurrent or convolutional neural networks networks [2]

[2] MIT Press (2016).

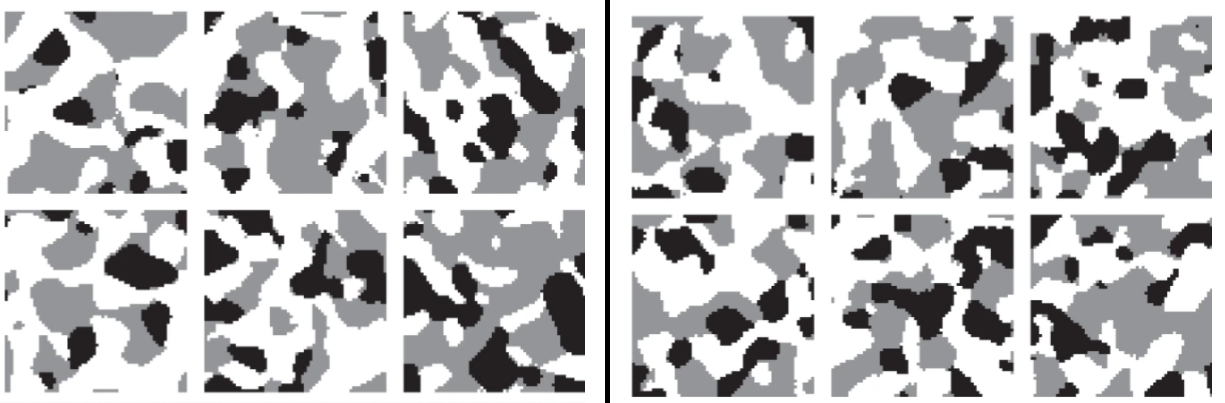

Generative adversarial networks for the generation of multiphase microstructural data

| Speaker: | Rana Kasrawi |

| Date: | 5.12.2024 |

Generative adversial networks (GANs) which are usually models for unsupervised learning have, for example, various applications in texture and image synthesis [3]. After training with a given data set of images, these networks can generate new images which are statistically similar to those of the training data set. Therefore, GANs can be considered to be spatial stochastic models. For example, in [4] a GAN was trained with with 3D image data depicting the three-phased microstructure of lithium-ion battery cathodes and solid oxide fuell cell anodes. Then, similar to a stochastic geometry model, the trained network is able to generate virtual, but realistic 3D image data.

[3] I.J. Goodfellow, J. Pouget-Abadie, M. Mirza, B. Xu, D. Warde-Farley, S. Ozair, A. Courville, Y. Bengio. Generative adversarial networks (2014). arXiv preprint arXiv:1406.2661.

[4] A. Gayon-Lombardo, L. Mosser, N.P. Brandon, S.J. Cooper. Pores for thought: generative adversarial networks for stochastic reconstruction of 3D multi-phase electrode microstructures with periodic boundaries. npj Computational Materials (2020), 6(1), 1-11.

Generative flows for multivariate stochastic modeling

| Date: | 12.12.2024 |

Real-valued non-volume preserving (NVP) transformations are a class of functions used to construct a general unsupervised learning algorithm for generative probabilistic modeling. Unsupervised learning has the great advantage of not requiring a ground-truth, which is often produced by time consuming hand labelling. The model is trained on four natural image data sets and produces sharp and realistic images, that are qualitatively competitive with other generative probabilistic modeling algorithms [5].

[5] L. Dinh, J. Sohl-Dickstein, and S. Bengio. "Density estimation using real nvp." arXiv preprint arXiv:1605.08803 (2016).

Text-to-Microstructure Generation Using Generative Deep Learning

| Speaker: | Marco Waltenberger |

| Date: | 19.12.2024 |

Although recent advances in deep generative networks have enabled the inverse design of material microstructures, most studies involve property-conditional generation and focus on a specific type of structure, resulting in limited generation diversity and poor human–computer interaction. In this study, a pioneering text-to-microstructure deep generative network (Txt2Microstruct-Net) is proposed that enables the generation of 3D material microstructures directly from text prompts without additional optimization procedures. The Txt2Microstruct-Net model is trained on a large microstructure-caption paired dataset that is extensible using the algorithms provided. Moreover, the model is sufficiently flexible to generate different geometric representations, such as voxels and point clouds. The model's performance is also demonstrated in the inverse design of material microstructures and metamaterials [6].

[6] , , , , , , Text-to-Microstructure Generation Using Generative Deep Learning. Small 2024, 20, 2402685.

Synthesizing controlled microstructures of porous media using generative adversarial networks and reinforcement learning

| Speaker: | Dominik Zeihsel |

| Date: | 09.01.2025 |

A deep learning method that can synthesize realistic three-dimensional microstructures with controlled structural properties using the combination of generative adversarial networks (GAN) and actor-critic (AC) reinforcement learning is proposed. The scientific contribution of this paper resides in the novel design of the GAN-AC microstructure generator and the mathematical and algorithmic foundations therein [7].

[7] Nguyen, P.C.H., Vlassis, N.N., Bahmani, B. et al. Synthesizing controlled microstructures of porous media using generative adversarial networks and reinforcement learning. Sci Rep 12, 9034 (2022).

Using convolutional neural networks for stereological characterization of 3D hetero-aggregates based on synthetic STEM data

| Speaker: | Annemarie Kamp |

| Date: | 16.01.2025 |

Since 3D imaging is complex and expensive, there are many approaches that attempt to reconstruct the information of a tomographic 3D image from a series of less expensive 2D measurements. In this work, the 3D microstructure of hetero-aggregates is predicted from 2D data. A stochastic model is used to generate synthetic training data on which a convolutional network can be trained [8]. Ultimately, the network can then be used to predict the associated 3D structure from a 2D image.

[8] L. Fuchs, T. Kirstein, C. Mahr, O. Furat, V. Baric, A. Rosenauer, L. Mädler and V. Schmidt, Using convolutional neural networks for stereological characterization of 3D hetero-aggregates based on synthetic STEM data. Machine Learning: Science and Technology 5 (2024), 025007.

Generating 3D images of material microstructures from a single 2D image: a denoising diffusion approach

| Speaker: | Philip Durdel |

| Date: | 23.01.2025 |

Three-dimensional (3D) images provide a comprehensive view of material microstructures, enabling numerical simulations unachievable with two-dimensional (2D) imaging alone. However, obtaining these 3D images can be costly and constrained by resolution limitations. A method capable of generating large-scale 3D images of material microstructures, such as metal or rock, from a single 2D image is introduced. The method combines a denoising diffusion probabilistic model with a generative adversarial network framework [9].

[9] Phan, J., Sarmad, M., Ruspini, L. et al. Generating 3D images of material microstructures from a single 2D image: a denoising diffusion approach. Sci Rep 14, 6498 (2024).

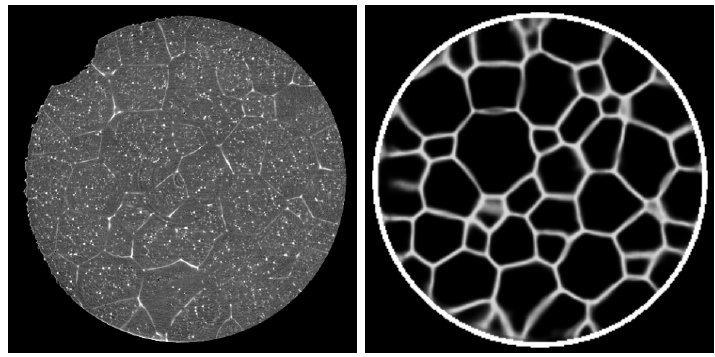

Generating multi-scale NMC particles with radial grain architectures using spatial stochastics and GANs

| Speaker: | Richard Bölz |

| Date: | 30.01.2025 |

A stereological generative adversarial network (GAN)-based model fitting approach is presented that can generate representative 3D information from 2D data, enabling characterization of materials in 3D using cost-effective 2D data. Once calibrated, this multi-scale model is able to rapidly generate virtual cathode particles that are statistically similar to experimental data, and thus is suitable for virtual characterization and materials testing through numerical simulations [10].

[10] L. Fuchs, O. Furat, D. P. Finegan, J. Allen, F. L.E. Usseglio-Viretta, B. Ozdogru, P. J. Weddle, K. Smith, V. Schmidt. Generating multi-scale NMC particles with radial grain architectures using spatial stochastics and GANs. arXiv preprint arXiv:2407.05333 (2024).

Generating three-dimensional structures from a two-dimensional slice with generative adversarial network-based dimensionality expansion

| Speaker: | Luis Pusch |

| Date: | 06.02.2025 |

Generative adversarial networks (GANs) can be trained to generate 3D image data based on 3D training data. However, the acquisition 3D image data for model calibration is a time consuming and expensive task. While 2D image data naturally contains much less information, it is possible in some cases that a cross-sectional 2D slice carries enough information to statistically reconstruct the 3D sample. Therefore, a particular GAN-architecture is introduced that is able to generate 3D data based on a single representative 2D image [11].

[11] S. Kench, S.J. Cooper, Generating three-dimensional structures from a two-dimensional slice with generative adversarial network-based dimensionality expansion. Nat Mach Intell 3, 299–305 (2021).

Calibration of stochastic geometry models by combining generative adversarial networks with excursion sets of random fields

| Speaker: | Ruoyu Wang |

| Date: | 13.02.2025 |

Generative adversarial networks (GANs) are a strong data-driven machine learning tool for generating new synthetic image data based on existing data. In order to create a sufficient data base for training these GANs, classical spatial stochastic modeling is deployed in order to generate a virtual data base used for network training. Subsequently, the trained GAN can be used to sample virtual images that can be further analyzed, for example in numerical simulations. This approach has been used to generate virtual data of all-solid-state battery cathodes [12].

[12] O. Furat, S. Weber, R. Rekers, J. Schubert, M. Luczak, E. Glatt, A. Wiegmann, J. Janek, A. Bielefeld and V. Schmidt, Generative adversarial framework to calibrate excursion set models for the 3D microstructure of all-solid-state battery cathodes. Working paper (under preparation)